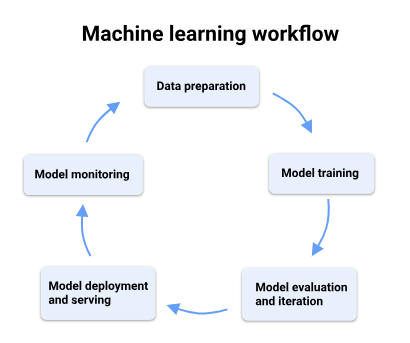

Trong bài này, các bạn sẽ được tìm hiểu tổng quan về machine learning workflow và cách mà Vertex AI được sử dụng để xây dựng và triển khai các mô hình.

Một machine learning Workflow sẽ có năm giai đoạn:

- Data preparation

- Model training

- Model evaluation

- Model deployment và serving

- Model monitoring

Data preparation

Ở bước này, chúng ta sẽ thực hiện một số công việc như làm trích xuất dữ liệu, làm sạch dữ liệu, EDA để hiểu hơn về dữ liệu và chia thành các tập train, validation, test phục vụ cho quá trình đào tạo và tinh chỉnh mô hình. Các bạn có thể thực hiện các công việc như trích xuất dữ liệu, làm sạch dữ liệu, EDA thông qua Vertex AI Workbench notebook, Vertex AI Workbench có thể tương tác một cách dễ dàng với Cloud Storage và BigQuery, điều này sẽ tạo điều kiện thuận lợi để xử lý và biến đổi dữ liệu một cách nhanh chóng hơn.

Đối với tập dữ liệu lớn, chúng ta có thể sử dụng Dataproc Serverless trong Vertex AI Workbench notebook để chạy Spark workloads mà không cần phải quản lý cụm Dataproc.

Model training

Đối với model training, chúng ta có một số công cụ sau:

- AutoML: Để đào tạo mô hình mà không cần viết mã

- Custom training: Để tự viết mã đào tạo và đào tạo các mô hình tùy chỉnh bằng các ML framework

- Vertex AI Vizier: Để điều chỉnh siêu tham số

- Vertex AI Experiments: Để tracking và so sánh các kết quả đào tạo

- Vertex AI Model Registry: Để đăng ký các mô hình đã đào tạo, thực hiện versioning và sẵn sàng cho giai đoạn đưa lên production. Vertex AI Model Registry tích hợp với các tính năng xác thực và triển khai như model evaluation và endpoints.

Model evaluation và iteration

Model serving

- Triển khai mô hình được custom-trained bằng cách sử dụng các prebuilt hoặc custom container để nhận online predictions theo thời gian thực (đôi khi được gọi là dự đoán HTTP).

- Thực hiện batch prediction bất đồng bộ mà không cần endpoints.

- Optimized TensorFlow runtime, chúng ta serving các mô hình TensorFlow với chi phí thấp hơn và độ trễ thấp hơn so với khi sử dụng các TensorFlow Serving containers open source được dựng sẵn.

- Đối với các trường hợp online serving với mô hình cho dữ liệu bảng, chúng ta sẽ sử dụng Vertex AI Feature Store để serving các feature từ kho lưu trữ trung tâm và theo dõi tình trạng của các feature.

- Vertex Explainable AI sẽ giúp chúng ta hiểu cách mỗi tính năng đóng góp vào kết quả dự đoán mô hình (feature attribution) như thế nào và tìm dữ liệu bị gắn nhãn sai từ tập dữ liệu đào tạo (example-based explanation).

- Deploy và nhận dự đoán trực tuyến cho các mô hình được đào tạo bằng BigQuery ML.

Model monitoring

Model monitoring có tác dụng giám sát hiệu suất của mô hình đã được triển khai. Sử dụng dữ liệu dự đoán để đào tạo lại mô hình nhằm cải thiện hiệu suất. Vertex AI Model Monitoring giúp giám sát các mô hình về độ lệch dự đoán (prediction drift), đồng thời còn có thể thông báo khi dữ liệu dự đoán lệch quá nhiều so với training baseline.

Leave a Reply